统计学中的“回归”是什么意思?

2024-12

浏览量:396

本文字数:1187

读完约 4 分钟

回归的词源本意

“回归”一词英文是“regression”,最初是由英国生物学家兼统计学家高尔顿(Francis Galton)在研究人类遗传问题时提出的。高尔顿在研究父母身高与子女身高的关系时发现,高个子父母的子女,其身高有向人群平均身高“回归”的趋势,矮个子父母的子女身高往往会比父母高,也有向平均身高靠近的倾向。这里的“回归”就是指一种趋向于中心值(平均身高)的现象。

统计学中的回归含义

概念:

在统计学中,回归是一种分析变量之间关系的方法。它主要用于研究一个因变量(也称为响应变量)与一个或多个自变量(也称为解释变量)之间的定量关系。简单来说,回归分析试图找到一个数学模型,通过自变量的取值来预测因变量的取值。

简单线性回归:

这是回归分析的基础形式。假设因变量和自变量之间存在线性关系,其模型可以表示为。其中是截距,表示当时的取值;是斜率,表示每增加一个单位时的变化量;是随机误差项,代表除之外的其他因素对的影响。例如,研究房屋售价与房屋面积之间的关系,通过收集一定数量的房屋数据(包括售价和面积),可以拟合出一个线性回归模型,从而根据房屋面积来预测房屋售价。

多元线性回归:

当因变量受到多个自变量影响时,采用多元线性回归模型。例如,在预测汽车的油耗时,自变量可能包括汽车的重量、发动机排量、行驶速度等多个因素,通过多元线性回归可以综合考虑这些因素对油耗的影响来建立预测模型。

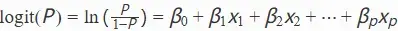

非线性回归:

如果变量之间的关系不是线性的,就需要采用非线性回归。例如,在研究细菌繁殖数量与时间的关系时,可能会发现它们之间是指数关系,如(其中是初始数量,是生长率),这种情况下就需要使用非线性回归来拟合模型,以准确描述变量之间的关系。

回归的目的和应用:

预测:

回归分析最重要的应用之一是预测。通过建立回归模型,利用已知的自变量数据来预测因变量的值。例如,企业可以根据广告投入、市场环境等自变量来预测产品的销售量(因变量),从而制定合理的生产和营销计划。

变量关系分析:

可以揭示变量之间的相互关系。通过回归系数(如等)可以了解自变量对因变量影响的方向和程度。例如,在研究教育程度与收入之间的关系时,回归系数可以告诉我们每增加一个教育程度单位(如学历层次的提升)对收入的正向影响程度。

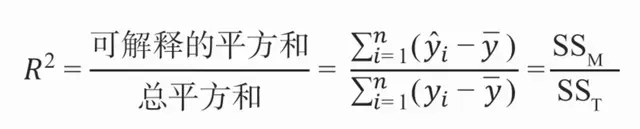

模型评估和比较:

可以评估不同模型对数据的拟合程度。常用的评估指标有均方误差(MSE)、决定系数等。通过比较不同模型的这些指标,可以选择最优的模型来解释和预测数据。例如,比较简单线性回归和多元线性回归模型对某一数据集的拟合效果,选择较高的模型作为更合适的预测工具。